Inteligencia artificial en el G7: el Papa advierte de los desafíos de la IA

El día 13 de junio se reunieron las personalidades políticas de numerosos países para poner en común temas que conciernen a la economía mundial: la lucha contra el cambio climático, las alianzas estratégicas con las naciones del continente africano, la peliaguda tesitura en la Guerra de Ucrania, el conflicto en la franja de Gaza y, destacablemente, el papel de la inteligencia artificial y su futuro en la sociedad.

El G7 es una agrupación de democracias bien establecidas creada en 1975 que se reúne cada año para tratar asuntos de actualidad y gran peso en el mundo. En este grupo se incluyen los Estados Unidos, Canadá, Francia, Alemania, Italia, Japón y Reino Unido.

Así pues, las personalidades más importantes que asistieron en representación de sus países han sido: Joe Biden, Justin Trudeau, Emmanuel Macron, Olaf Scholz, Giorgia Meloni, Fumio Kishida y Rishi Sunak. A su vez, representando a la Unión Europea en su conjunto, acudieron Ursula von der Leyen y Charles Michel.

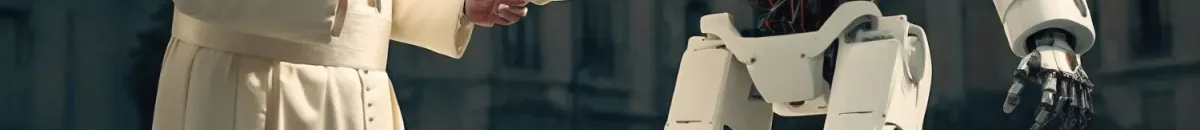

También vinieron los presidentes y figuras públicas equivalentes de muchos otros países alrededor del mundo que tienen lazos con Occidente. Sin embargo, la participación más destacada de la cumbre del G7 de 2024 ha sido nada más y nada menos que… ¡la del Papa Francisco!

Antecedentes de la inteligencia artificial en el G7

Desde que la IA generativa se popularizó con software como ChatGPT, Gemini o Midjourney, los gobiernos y las grandes empresas han tomado especial interés en el funcionamiento y las aplicaciones de la inteligencia artificial por cuestiones económicas y morales.

Esto dio pie, ya en 2021, a que la Unión Europea redactase y aprobase por mayoría absoluta una Ley de Inteligencia Artificial, que es la primera regulación integral de la IA a nivel mundial que vela por la seguridad y buena praxis de la inteligencia artificial en todos los países miembros.

La Ley clasifica los sistemas de IA en cuatro categorías de riesgo según su potencial daño. Los sistemas de alto riesgo, como los utilizados en la atención médica o el transporte, están sujetos a requisitos estrictos, mientras que los de bajo riesgo, como chatbots o filtros de spam, tienen menos obligaciones. La ley prohíbe los sistemas que suponen un riesgo inaceptable, como aquellos que manipulan el comportamiento humano de forma peligrosa o utilizan el reconocimiento facial para la vigilancia masiva.

La formulación de esta ley, a todas luces insuficiente para los retos que plantea la inteligencia artificial actualmente, puso de relieve la necesidad de seguir dilucidando el papel de una tecnología emergente que crece a toda velocidad como es la IA y la actuación deseable de las autoridades políticas ante su permeación en todos los aspectos de la vida de los ciudadanos.

¿Qué se ha dicho en la cumbre del G7 sobre la inteligencia artificial?

La sociedad y, especialmente, los líderes políticos no se han concienciado del todo sobre lo que supone la irrupción y la generalización de la IA en todos los ámbitos de la vida. Es por eso que un punto troncal de la última cumbre del G7 ha sido la inteligencia artificial.

En esta reunión internacional, los presidentes y primeros ministros de las democracias occidentales abordaron el tema de la IA desde diferentes perspectivas: cómo pueden los países y sus Estados aprovecharla en aras del progreso económico, cuáles son sus riesgos y cómo podrían mitigarse.

Esto va en línea con el Proceso de IA de Hiroshima organizado por el G7 en mayo de 2023 con el objetivo de crear y promover una inteligencia artificial segura y fiable en relación con la protección de datos. Esta cumbre pretendía dar una respuesta anticipada a las preocupaciones crecientes sobre la IA generativa como ChatGPT y los dilemas emergentes que plantea la inteligencia artificial.

El discurso del Papa sobre la inteligencia artificial en la cumbre del G7

Para sorpresa de todos, el personaje público que más trató los límites de la inteligencia artificial no ha sido un político, sino el sumo pontífice de Roma.

En su conferencia, el Papa ha señalado la naturaleza única de la inteligencia artificial que la distingue de otras mil invenciones tecnológicas que han ido sucediéndose poco a poco a lo largo de la historia de la humanidad:

Pero la inteligencia artificial es una herramienta aún más compleja. Yo diría que es una herramienta sui generis. Así, mientras que el uso de una herramienta simple —como un cuchillo— está bajo el control del ser humano que lo utiliza y su buen uso depende solo de él, la inteligencia artificial, en cambio, puede adaptarse de forma autónoma a la tarea que se le asigne y, si se diseña de esa manera, podría tomar decisiones independientemente del ser humano para alcanzar el objetivo fijado.

En su conferencia sobre inteligencia artificial, el Papa destacó tanto las promesas como los peligros de la inteligencia artificial. Subrayó que la inteligencia artificial es un producto del potencial creativo humano que puede democratizar el acceso al conocimiento y liberar a las personas de trabajos con un grado elevado de penosidad.

Peligros y oportunidades de la IA

A su vez, advierte que si los gobiernos no ponen coto al uso indiscriminado de la inteligencia artificial, esta podría llevar a aumentar las desigualdades y fomentar una cultura del descarte.

Además, el Papa señaló que la inteligencia artificial debe contemplarse como una herramienta y no como un fin en sí mismo. Por tanto, deberemos evaluar su utilidad en función del impacto positivo o negativo que ejerza en la sociedad, criterio que dependerá de cómo se utilice y de las consecuencias que se deriven de su buen o mal uso.

Hizo hincapié en mantener un control humano definitivo sobre las decisiones que toman las máquinas en áreas críticas como los conflictos armados como el de la franja de Gaza o Ucrania, donde las decisiones de vida o muerte no deben dejarse a dispositivos autónomos.

En definitiva, en el G7 se habló de los peligros y oportunidades de la inteligencia artificial en relación con el bien común.

Artículos relacionados

Robótica cognitiva: una gran oportunidad para la inteligencia artificial

La robótica cognitiva busca comprender los modelos cognitivos que rigen la inteligencia humana y plasmarlos en robots. Su objetivo es hacer posible

Tecnologías futuristas que están a la vuelta de la esquina

En el habla cotidiana, entendemos que lo futurista es una visión orientada al futuro en lo referente a todo el conjunto de dispositivos tecnológicos p

El futuro de la IA: posibles avances y retos

En EducaOpen sabemos de primera mano que el avance de las tecnologías es imparable.